Что пишут в блогах

- Как нагрузочное тестирование защищает бизнес от убытков?

- Исследовательское тестирование и UX‑аудит для интернет-магазина

- Юзабилити‑тестирование без розовых очков: почему идеальный функционал не спасёт от провала?

- А ваши тестировщики защищают ваш продукт и компанию от миллионных штрафов?

- TechWriter Days 3. Как это было

- Ричард Румельт. Взлом стратегии.

- Должны ли разработчики тестировать свой код

- Мои 12 недель в году. Часть 33 (вышла книга по SQL, закончила книгу про ИИ)

- Почему SaaS падает при росте нагрузки?

- Как рассчитать реальный предел SaaS

Что пишут в блогах (EN)

- Autonomous Testing has Landed: Welcome BearQ, by SmartBear

- The Autonomous Testing Tipping Point (Part 2)

- Dr. AI Yourself?

- The Autonomous Testing Tipping Point (Part 1)

- Test Automation Days Follow Up

- (Un)Ethical AI

- Rabbit, Meet Unemployment Line

- ATD 2026 – The Great Liberation: Software Testing in the Age of AI

- AI and Testing: Improving Retrieval Quality, Part 3

- AI and Testing: Improving Retrieval Quality, Part 2

Онлайн-тренинги

-

Программирование на Python для тестировщиковНачало: 22 мая 2026

-

Тестирование REST APIНачало: 25 мая 2026

-

Школа Тест-АналитикаНачало: 27 мая 2026

-

Python для начинающихНачало: 28 мая 2026

-

Азбука ИТНачало: 28 мая 2026

-

Школа для начинающих тестировщиковНачало: 28 мая 2026

-

Тестирование производительности: JMeter 5Начало: 29 мая 2026

-

Bash: инструменты тестировщикаНачало: 4 июня 2026

-

Docker: инструменты тестировщикаНачало: 4 июня 2026

-

SQL: Инструменты тестировщикаНачало: 4 июня 2026

-

Chrome DevTools: Инструменты тестировщикаНачало: 4 июня 2026

-

Git: инструменты тестировщикаНачало: 4 июня 2026

-

Инженер по тестированию программного обеспеченияНачало: 4 июня 2026

-

Аудит и оптимизация процессов тестированияНачало: 5 июня 2026

-

Практикум по тест-дизайну 2.0Начало: 5 июня 2026

-

Логи как инструмент тестировщикаНачало: 8 июня 2026

-

Техники локализации плавающих дефектовНачало: 8 июня 2026

-

Автоматизация тестов для REST API при помощи PostmanНачало: 11 июня 2026

-

Тестирование GraphQL APIНачало: 11 июня 2026

-

Применение ChatGPT в тестированииНачало: 11 июня 2026

-

Регулярные выражения в тестированииНачало: 11 июня 2026

-

CSS и Xpath: инструменты тестировщикаНачало: 11 июня 2026

-

Charles Proxy как инструмент тестировщикаНачало: 11 июня 2026

-

Программирование на Java для тестировщиковНачало: 12 июня 2026

-

Тестировщик ПО: интенсивный курс (ПОИНТ) со стажировкойНачало: 16 июня 2026

-

Автоматизация тестирования REST API на JavaНачало: 17 июня 2026

-

Автоматизация тестирования REST API на PythonНачало: 17 июня 2026

-

Тестирование безопасностиНачало: 17 июня 2026

-

Тестирование мобильных приложений 2.0Начало: 17 июня 2026

-

Автоматизация функционального тестированияНачало: 19 июня 2026

-

Школа тест-менеджеров v. 2.0Начало: 24 июня 2026

-

Тестирование веб-приложений 2.0Начало: 26 июня 2026

-

Тестирование без требований: выявление и восстановление информации о продуктеНачало: 29 июня 2026

-

Организация автоматизированного тестированияНачало: 3 июля 2026

-

Программирование на C# для тестировщиковНачало: 3 июля 2026

-

Создание и управление командой тестированияНачало: 16 июля 2026

| Лучшие практики автоматизации тестирования: 9 принципов стабильных автотестов |

| 13.04.2026 00:00 |

|

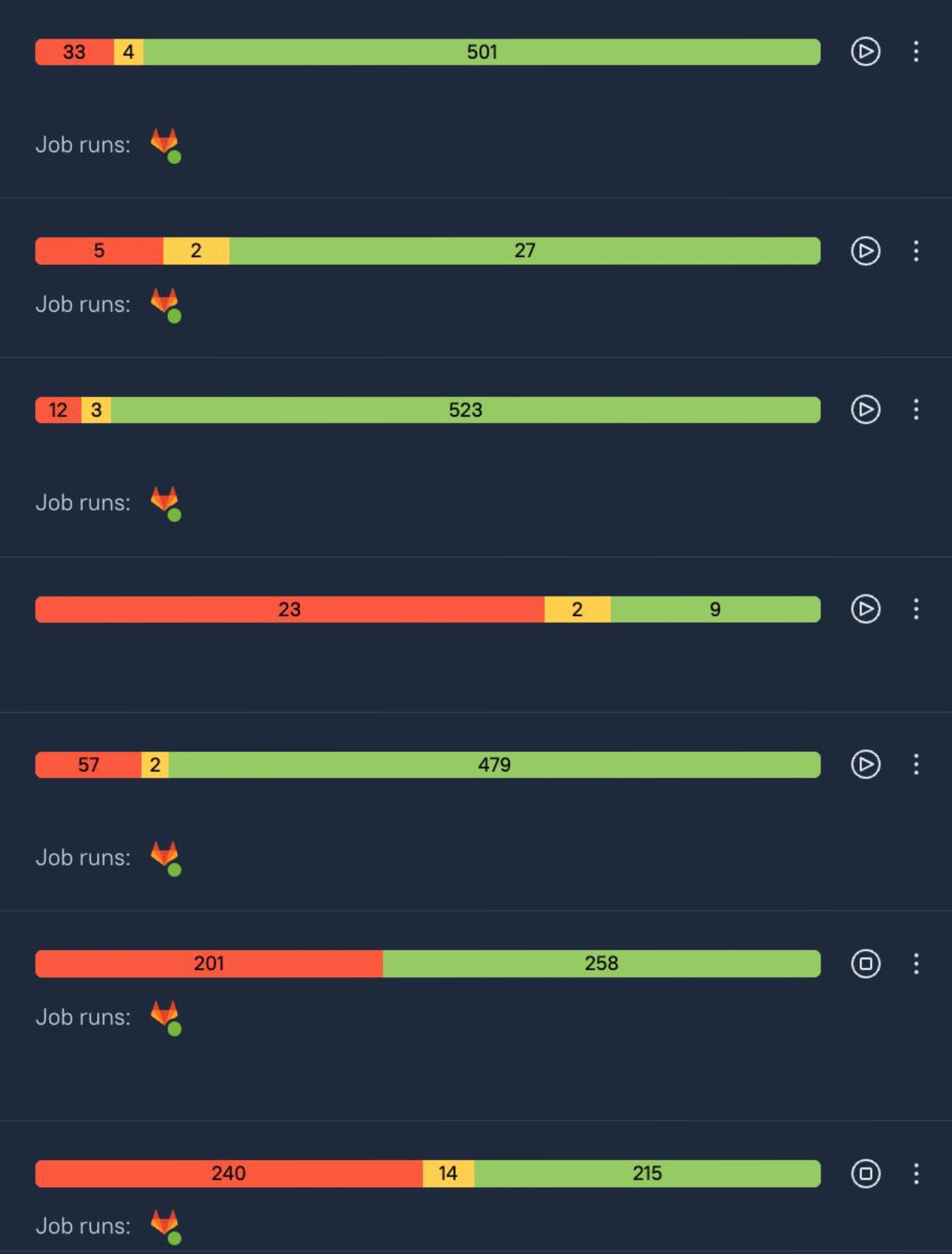

Автор: Никита Филонов, автор курса «Автоматизация тестирования UI + API с Python» Представьте утро. Вы открываете ноутбук, заходите в Allure — и видите красное море.

Падает половина автотестов, часть — «временно», часть — «иногда». Почти каждый день начинается с одних и тех же починок, дебага и «вроде теперь стабильно». Знакомо? Скорее всего да, иначе вы бы не открыли эту статью. Сегодня хочу спокойно, без паники и взаимных обвинений, взглянуть на эту ситуацию со стороны. Почему тесты ведут себя так непредсказуемо? Откуда берётся эта нестабильность, и почему она кажется вечной? На самом деле это не случайность. Это закономерный итог накопленных технических решений, компромиссов и, порой, отсутствия инженерной стратегии. Каждый упавший тест — это не просто «флак» или «ошибка окружения». Это пропущенная проверка, потерянное доверие и часы бесполезных фиксов. Если таких тестов сотни, то со временем автотесты перестают быть инструментом качества — и превращаются в источник шума. Но из этого есть выход. Разберём, как подойти к автоматизации осознанно, чтобы тесты действительно помогали, а не мешали. Никакой философии, только инженерные практики и работающие приёмы. 1. Не пишите огромные E2E-тестыДопустим, перед вами стоит задача: проверить регистрацию пользователя и получение письма для подтверждения. Как большинство команд обычно решает эту задачу? Открывается браузер через Selenium или Playwright, пользователь проходит регистрацию, отправляется письмо, тест ждёт его появления в почтовом ящике, парсер извлекает код подтверждения — и этот код вводится обратно через UI. Получается большой, сложный и хрупкий E2E‑тест, который тяжело запускать, поддерживать и отлаживать. Любая задержка на стороне почты, сбой сети или нестабильный селектор приведёт к падению. В результате — длинный сценарий, который проверяет всё и сразу, но в итоге не гарантирует ничего. Как сделать правильно?Если цель — убедиться, что при регистрации пользователь получает корректный код, то достаточно разбить сценарий на несколько атомарных тестов, каждый из которых проверяет свой уровень. Например:

Такой подход даёт несколько преимуществ:

И самое главное — теперь эти тесты можно спокойно запускать в CI/CD, не опасаясь случайных падений. 2. Используйте мокиМоки — это не только про юнит‑тесты. Их можно (и нужно) использовать на всех уровнях — от интеграционных до UI и E2E. Это инструмент, который даёт изоляцию, контроль и предсказуемость поведения системы. Зачем это нужно?Когда под вашим приложением десятки или сотни микросервисов, любая цепочка интеграций становится потенциальной точкой отказа. Один сервис не ответил, другой завис — и половина тестов внезапно падает. Причина не в коде, а в среде. Мок‑сервисы позволяют убрать этот фактор случайности. Вы поднимаете простой сервис, который эмулирует API или очередь сообщений, и заменяете реальные вызовы на предсказуемые ответы. В результате тест проверяет логику приложения, а не стабильность сети. Пример с UI-тестамиПредставьте, что вы тестируете фронт на Playwright. Под ним — API gateway, за ним — десятки сервисов. Любое замедление или зависание на backend‑стороне превращает тесты в лотерею. Решение простое: поднимите мок API gateway, который отдаёт фейковые, но детерминированные ответы. UI останется в том же окружении, а вероятность флаков упадёт в разы. Пример с микросервисомЕсли вы тестируете отдельный сервис, ничего не мешает замокать все внешние зависимости — базы, очереди, партнёрские API. Такой подход превращает интеграционные тесты в изоляционные: вы проверяете не инфраструктуру, а поведение конкретного сервиса в контролируемой среде. Часто это реализуется просто:

Почему это работает?

Когда тесты становятся «бесплатными»Самое интересное — эффект масштаба. Пока тестов 20–30, никто не думает о времени запуска. Но когда их сотни, каждый новый тест становится болью: прогон медленный, CI тормозит, а локальный запуск невозможен. С моками всё иначе. Тесты запускаются быстро, надёжно и предсказуемо. Добавить новый сценарий — не проблема, потому что инфраструктура не становится узким местом. В итоге писать автотесты перестаёт быть риском, а становится естественным шагом в процессе разработки.

А как же покрытие?Иногда звучит аргумент: «Если всё замокано, мы же не тестируем реальную систему». На деле всё наоборот. С моками вы получаете качественное покрытие на уровне логики, не засорённое шумом внешних факторов. Контракты, бизнес‑правила, фильтры, сообщения в Kafka — всё это можно проверять быстро и стабильно. А интеграционный смоук по «живой» системе можно оставить минимальным — он лишь подтверждает, что окружение живо. 3. Держите быстрый смоук интеграционных тестовПолностью отказываться от автотестов на реальном окружении не стоит. Но их объём должен быть минимальным и целевым. Оставьте буквально один‑два happy‑path теста на каждую ключевую фичу — простые, линейные, без сложной подготовки и без зависимости от большого количества данных. Такие тесты не должны проверять всю бизнес‑логику. Их задача совсем другая: быстро показать, что система в принципе работает. Что такое «быстрый смоук»Смоук‑набор — это небольшая группа тестов, которые служат индикатором здоровья окружения. Если что‑то отвалилось в инфраструктуре — стенд недоступен, сервис не отвечает, контракт разъехался — смоук это сразу покажет. Если же смоук зелёный, можно быть уверенным, что платформа в целом жива и готова к более детальной проверке. Где живёт бизнес-логика?Основная логика системы должна проверяться на уровне изоляционных тестов — там, где всё контролируемо, быстро и стабильно. Именно там можно позволить себе сотни сценариев, вариации данных, проверку крайних случаев. Интеграционный смоук — это не конкурент, а страховочная сетка. Он не доказывает, что бизнес‑функционал идеален, но показывает, что всё вообще поднято, соединено и реагирует. Почему это важно?

4. Не завязывайтесь на реализациюОдна из самых частых ловушек в автоматизации — привязка тестов к внутренней реализации. Например, под сервисом лежит база данных, и тест лезет прямо в таблицу, чтобы убедиться, что запись там появилась. На первый взгляд — удобно. На практике — источник бесконечных проблем. Почему это плохо?Когда тесты напрямую обращаются к внутренним структурам — ORM, таблицам, файлам, приватным API — они перестают быть тестами поведения и становятся тестами внутренностей. Любая оптимизация в архитектуре (новая схема БД, другой ORM, перенос данных в другой сервис) ломает десятки таких тестов. При этом для внешнего клиента ничего не изменилось — контракты остались те же, но тесты уже «всё видят иначе» и требуют переписывания. Что нужно проверять?Тесты должны проверять контракты, а не реализацию. То есть:

Так вы подтверждаете, что система ведёт себя корректно снаружи, независимо от того, что внутри. Классический сценарийАвтоматизатор пишет тест, который после выполнения запроса идёт в базу и проверяет таблицу И теперь тесты ломаются не потому, что система работает неправильно, а потому что они знали слишком много. Как правильно?

Пример принципа на практике5. Пишите автотесты сразу с фичейОдин из самых сильных приёмов — начинать писать автотесты вместе с фичей, а не после релиза. Этот подход известен как Left Shift Testing — когда тестирование «сдвигается влево», ближе к разработке. Почему это важно?Если писать тесты одновременно с фичей, вы постепенно приближаетесь к почти идеальному покрытию. Каждая новая задача приносит свои тесты, а каждая доработка — обновляет существующие. Через несколько спринтов вы обнаружите, что у вас уже есть автотесты на большую часть бизнес‑логики, и система закрыта проверками естественным образом, без отдельного «проекта по покрытию». Как это выглядит на практике

Такая структура естественно встраивает тесты в процесс разработки — без «отдельного цикла тестирования после». Преимущества подхода

6. Держите автотесты максимально простымиХорошие автотесты — это не те, что «умные», а те, что понятные и предсказуемые. Тест не должен быть архитектурным произведением искусства. Он должен быстро показать: система работает — или нет. Почему это важно?Чем «умнее» становится тест, тем выше риск, что он начнёт жить своей жизнью: обрастёт вспомогательными классами, логикой, ветвлениями, фейкерами и «временными костылями». В итоге тест сам превращается в мини‑программу со своими багами. Простота — это надёжность

Пример

7. Тестируйте свои тестыУ тестов тоже есть код. И этот код ничем не отличается от продуктового: у него есть зависимости, побочные эффекты, ошибки и регрессии. Почему это важно?Любая тестовая инфраструктура — это тоже программа. Генераторы данных, HTTP/gRPC‑клиенты, парсеры ответов, сериализаторы, фикстуры, репортеры, нотификаторы — всё это полноценные компоненты, от которых напрямую зависит достоверность результатов тестирования. Если они ломаются, вы получаете ложные падения, неверные проверки или — что хуже всего — зелёные тесты, которые ничего не проверяют. Классическая ситуацияКто‑то вносит «маленькое улучшение» в общий helper. Например, меняет JSON‑парсер, добавляет кэширование или переписывает логику клиента. Через минуту сто тестов начинают вести себя «странно»:

И самое опасное — тесты выглядят зелёными. Что делать?

ПримерТеперь, если кто‑то изменит парсер или клиент, вы сразу узнаете — до того, как начнут сыпаться сотни тестов. 8. Привлекайте разработчиковЕсли тесты лежат в стороне от кода, разработчики их не видят, не запускают и не чувствуют за них ответственности. А если они изолированы в том же репозитории — они становятся частью инженерного процесса, а не «магией QA». Почему это важно?Разработчики — не враги автоматизации. Они просто не будут работать с тестами, если те выглядят как отдельная система со своими правилами, фреймворками и 200 магическими фикстурами. Изоляционные тесты (или «изоляты») решают эту проблему идеально. Это тесты, которые живут рядом с кодом, используют те же моки, те же модели, те же типы и инфраструктуру. Разработчик может запустить их локально, отдебажить и даже дописать свой кейс — без барьера входа. Как этого добиться

ПримерФайлы 9. Как не нужно делатьИногда проще «залить» проблему ресурсами или костылями, чем разобраться с корнем. Но в автоматизации тестирования это путь в тупик. Ни один из этих приёмов не решает проблему стабильности — он лишь отодвигает момент, когда система начнёт рушиться окончательно. 1. Не заливайте проблемы железомЕсли у вас десятки микросервисов, асинхронные процессы, очереди, Kafka, RabbitMQ или Temporal — рост ресурсов не спасёт. Да, можно нарастить CPU, память, диски, увеличить лимиты, и тесты на какое‑то время «зашумят меньше». Но через неделю всё вернётся: версии сервисов разъедутся, контракты рассинхронизируются, появятся тайминговые ошибки, сеть моргнёт, очередь переполнится. Проблема не в железе, а в сложности интеграций и отсутствии изоляции. Если тесты флакнут из‑за окружения — решать нужно архитектурно: через моки, контейнеризацию, изоляцию и контроль контрактов. Увеличение ресурсов лечит симптомы, но не болезнь. 2. Не пытайтесь лечить нестабильность ретраямиРетрай создаёт иллюзию надёжности и часто маскирует реальные проблемы.

В языке Go, например, ретраев в принципе нет — философия проста:

3. Не усложняйте фреймворк — чем проще, тем надёжнееМногие команды пытаются «перерасти» простые тесты и начинают писать собственные фреймворки: добавляют кастомные вейтеры, логи, анализаторы, перезапуски, кастомные докер‑менеджеры, централизованные оркестраторы и прочие «инновации». Через пару месяцев тесты перестают быть тестами. Они становятся маленькой экосистемой, где непонятно, где заканчивается проверка и начинается инфраструктура. Любое изменение превращается в риск. Простой факт:

Минимизируйте фреймворк, оставив только то, что действительно нужно. Фреймворк — это не место для ретраев, таймеров и «умных» вейтеров. Он должен быть простым каркасом: запуск, репортинг, базовые утилиты. Всё остальное — лишний вес. ЗаключениеМоки, изоляция, атомарность и минимализм. Этого достаточно, чтобы тесты были стабильными, быстрыми и по делу. Если вы читали эту статью и ловили себя на мысли, что половина примеров вам знакома — это нормально. Почти все через это проходили: флаки, костыли, ретраи, «магические» фреймворки и CI, который живёт своей жизнью. Проблема здесь не в инструментах, а в подходе. Стабильная автоматизация начинается с архитектуры, изоляции и инженерного мышления — а не с очередной библиотеки-«комбайна». |